Giáo sư Geoffrey Hinton của Đại học Toronto, thường được gọi là “Bố già của AI” gần đây đã nghỉ việc tại Google để có thể tự do chia sẻ những quan điểm cá nhân về lĩnh vực mà ông đã đi tiên phong. Ông đã thấy sự gia tăng gần đây của các AI như ChatGPT và BingAI với những dấu hiệu của sự tăng tốc không được kiểm soát và có khả năng gây nguy hiểm trong quá trình phát triển. Trong khi đó, Google dường như đã từ bỏ sự kiềm chế trước đây của mình khi đuổi theo các đối thủ cạnh tranh bằng các sản phẩm như chatbot Bard.

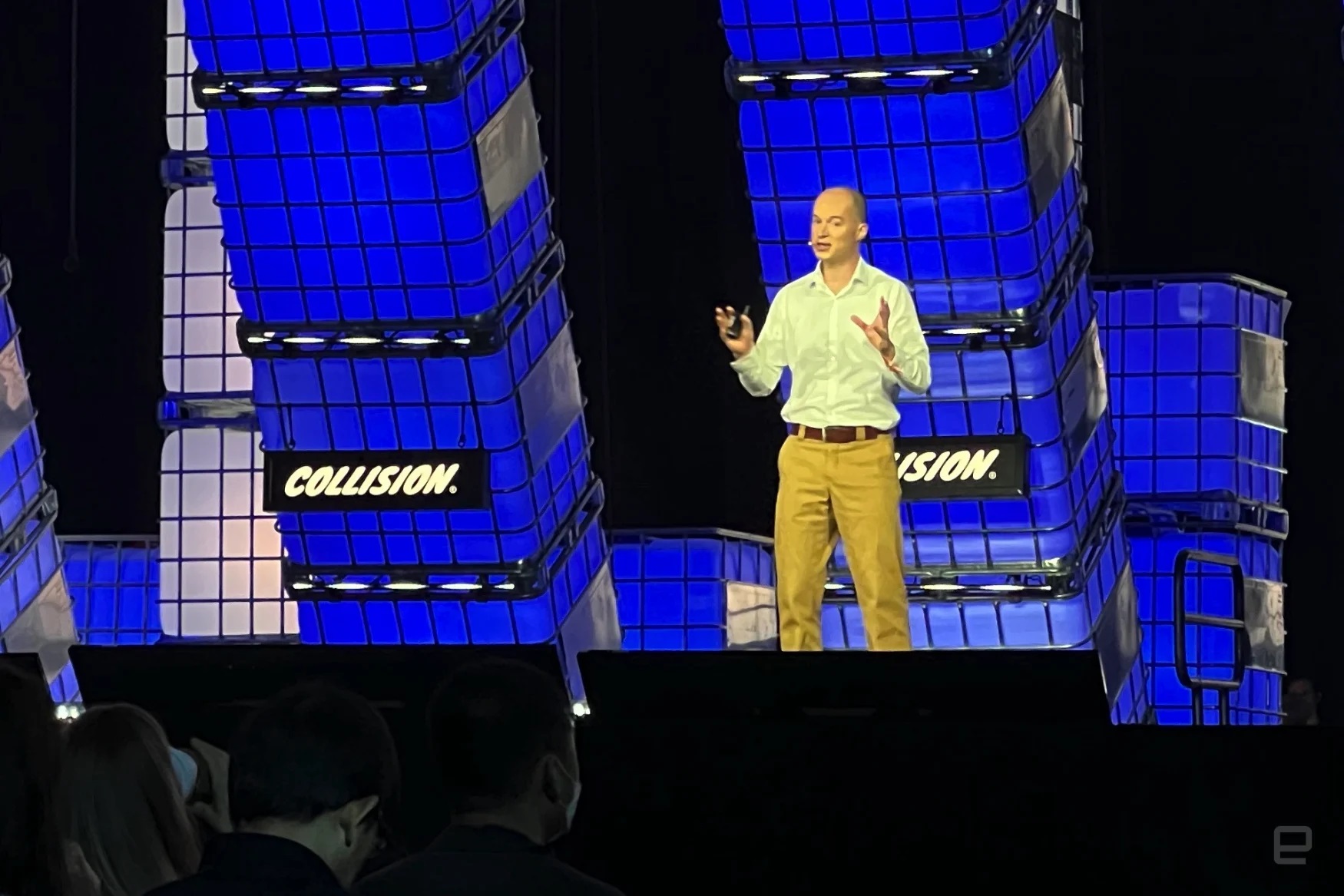

Tại hội nghị Collision tuần này ở Toronto, Hinton đã mở rộng mối quan tâm của mình. Trong khi các công ty đang quảng cáo AI là giải pháp cho mọi thứ, từ ký hợp đồng cho thuê đến vận chuyển hàng hóa, thì Hinton đã gióng lên hồi chuông cảnh báo. Ông không tin rằng AI tốt sẽ chiến thắng AI xấu và ông cũng tin rằng việc áp dụng AI có đạo đức có thể phải trả giá đắt.

Một mối đe dọa cho nhân loại

Hinton chia sẻ: "Tôi không tin rằng một AI tốt đang cố gắng ngăn chặn cái xấu lại có thể kiểm soát được. Có thể khó ngăn tổ hợp công nghiệp quân sự sản xuất robot chiến đấu chẳng hạn. Các công ty và quân đội có thể "yêu thích" các cuộc chiến tranh mà nạn nhân là những cỗ máy có thể dễ dàng thay thế".

Hinton tin rằng các mô hình ngôn ngữ lớn (AI được đào tạo để tạo ra văn bản giống con người, như GPT-4 của OpenAI) có thể dẫn đến sự gia tăng mạnh mẽ về năng suất. Ông lo ngại rằng giai cấp đứng đầu có thể chỉ đơn giản là khai thác điều này để làm giàu cho bản thân, làm gia tăng khoảng cách giàu nghèo vốn đã lớn. Nó sẽ "làm cho người giàu giàu hơn và người nghèo nghèo hơn", Hinton nói.

Hinton cũng nhắc lại quan điểm đã được công bố rộng rãi của mình rằng AI có thể đặt ra một rủi ro hiện hữu đến nhân loại. Nếu trí tuệ nhân tạo trở nên thông minh hơn con người, không có gì đảm bảo rằng con người sẽ tiếp tục nắm quyền. Hinton nói: "Chúng ta đang gặp rắc rối" nếu AI quyết định rằng việc nắm quyền kiểm soát là cần thiết để đạt được mục tiêu của nó. Đối với ông, các mối đe dọa "không chỉ là khoa học viễn tưởng". Ông lo lắng rằng xã hội sẽ chỉ kiềm chế những người máy giết người sau khi họ có cơ hội thấy chúng “khủng khiếp đến mức nào".

Có rất nhiều vấn đề đang tồn tại, Hinton nói thêm. Ông lập luận rằng thiên vị và phân biệt đối xử vẫn là vấn đề, vì dữ liệu đào tạo AI bị sai lệch có thể tạo ra kết quả không công bằng. Các thuật toán cũng tạo ra lỗ hổng khiến thông tin sai lệch và các vấn đề sức khỏe tâm thần nghiêm trọng hơn. Hinton cũng lo lắng về việc AI sẽ lan truyền thông tin sai lệch. Ông không chắc liệu có thể nắm bắt được mọi yêu cầu không có thật hay không, mặc dù điều quan trọng là phải đánh dấu mọi thứ giả mạo một cách rõ ràng..

Điều này không có nghĩa là Hinton thất vọng về tác động của AI, mặc dù ông cảnh báo rằng việc sử dụng công nghệ lành mạnh có thể phải trả giá đắt. Con người có thể phải tiến hành “công việc thực nghiệm” để hiểu AI có thể sai như thế nào và ngăn không cho nó giành quyền kiểm soát. Ông nói thêm rằng việc sửa chữa những thành kiến là “có thể thực hiện được”.

Vị giáo sư đã không cắt xén từ ngữ trong câu trả lời của mình cho các câu hỏi về việc mọi người mất việc do tự động hóa. Ông cảm thấy rằng việc giải quyết bất bình đẳng là cần thiết và mọi người có thể chống lại tình trạng thất nghiệp bằng cách theo đuổi những nghề nghiệp có thể thay đổi theo thời gian. Thực tế, xã hội có thể phải thực hiện những thay đổi lớn để thích ứng với AI.

Triển vọng ngành vẫn lạc quan

Các cuộc đàm phán trước đó tại Collision mang nhiều hy vọng hơn. Giám đốc kinh doanh Google DeepMind Colin Murdoch cho biết trong một cuộc thảo luận khác rằng AI đang giải quyết một số thách thức khó khăn nhất trên thế giới.

Murdoch đã hình dung ra “trí thông minh tổng hợp nhân tạo” có thể giải quyết nhiều vấn đề và lấy các sản phẩm của Google làm ví dụ. Murdoch đã đi xa đến mức gọi 6 đến 12 tháng qua là “thời điểm bùng nổ” đối với AI.

Nhà khoa học trưởng của Roblox Morgan McGuire cũng đồng ý với phần lớn quan điểm kể trên. Ông ấy tin rằng nền tảng của AI sáng tạo “thu hẹp khoảng cách” giữa những người sáng tạo mới và những người kỳ cựu, giúp việc viết mã và tạo tài liệu trở nên dễ dàng hơn. Roblox thậm chí còn phát hành một mô hình AI mã nguồn mở có tên StarCoder với hy vọng sẽ hỗ trợ những người khác bằng cách làm cho các mô hình ngôn ngữ lớn dễ tiếp cận hơn.

McGuire trong một cuộc thảo luận trước đó cũng thừa nhận những thách thức trong việc nhân rộng và kiểm duyệt nội dung, ông tin rằng siêu dữ liệu nắm giữ khả năng “không giới hạn” nhờ vào nhóm sáng tạo của nó.

Cả Murdoch và McGuire đều bày tỏ một số mối quan tâm giống như Hinton, nhưng giọng điệu của họ rõ ràng là ít gây hoang mang hơn. Murdoch nhấn mạnh rằng DeepMind muốn AI “an toàn, có đạo đức và toàn diện”, đồng thời chỉ ra các cuộc tư vấn của chuyên gia và đầu tư giáo dục làm bằng chứng. Vị Giám đốc điều hành này khẳng định rằng ông sẵn sàng tuân theo quy định, nhưng chỉ khi nào nó cho phép “những đột phá đáng kinh ngạc”. Đổi lại, McGuire cho biết Roblox luôn tung ra các công cụ AI chung với kiểm duyệt nội dung, dựa trên các tập dữ liệu đa dạng và thực hành minh bạch.

Một số hy vọng cho tương lai

Thực tế, sự nhiệt tình của "Bố già AI" Hinton đối với trí thông minh nhân tạo không hề giảm sút sau khi rời Google. Nếu không bỏ việc, ông ấy chắc chắn rằng mình sẽ làm việc trên các mô hình AI đa phương thức, nơi tầm nhìn, ngôn ngữ và các tín hiệu khác giúp đưa ra các quyết định. “Trẻ nhỏ không chỉ học ngôn ngữ đơn thuần,” ông nói, gợi ý rằng máy móc cũng có thể làm như vậy. Dù lo lắng về sự nguy hiểm của AI, ông ấy vẫn tin rằng cuối cùng nó có thể làm bất cứ điều gì mà con người có thể làm và đã thể hiện “một chút suy luận”. Chẳng hạn, GPT-4 có thể tự điều chỉnh để giải các câu đố khó hơn.

Hinton thừa nhận rằng sự tiến bộ của công nghệ AI có thể là lành mạnh, ngay cả khi điều quan trọng là phải lo lắng về những tác động xấu mà nó có thể dẫn tới. Và Hinton tự do thừa nhận rằng sự nhiệt tình của ông không hề giảm sút mặc dù những vấn đề về đạo đức và luân lý đang rình rập. “Tôi thích thứ này (AI),” ông nói. “Làm sao bạn có thể không thích làm những thứ thông minh cơ chứ?”

Diêm Vỹ (theo Engadget)